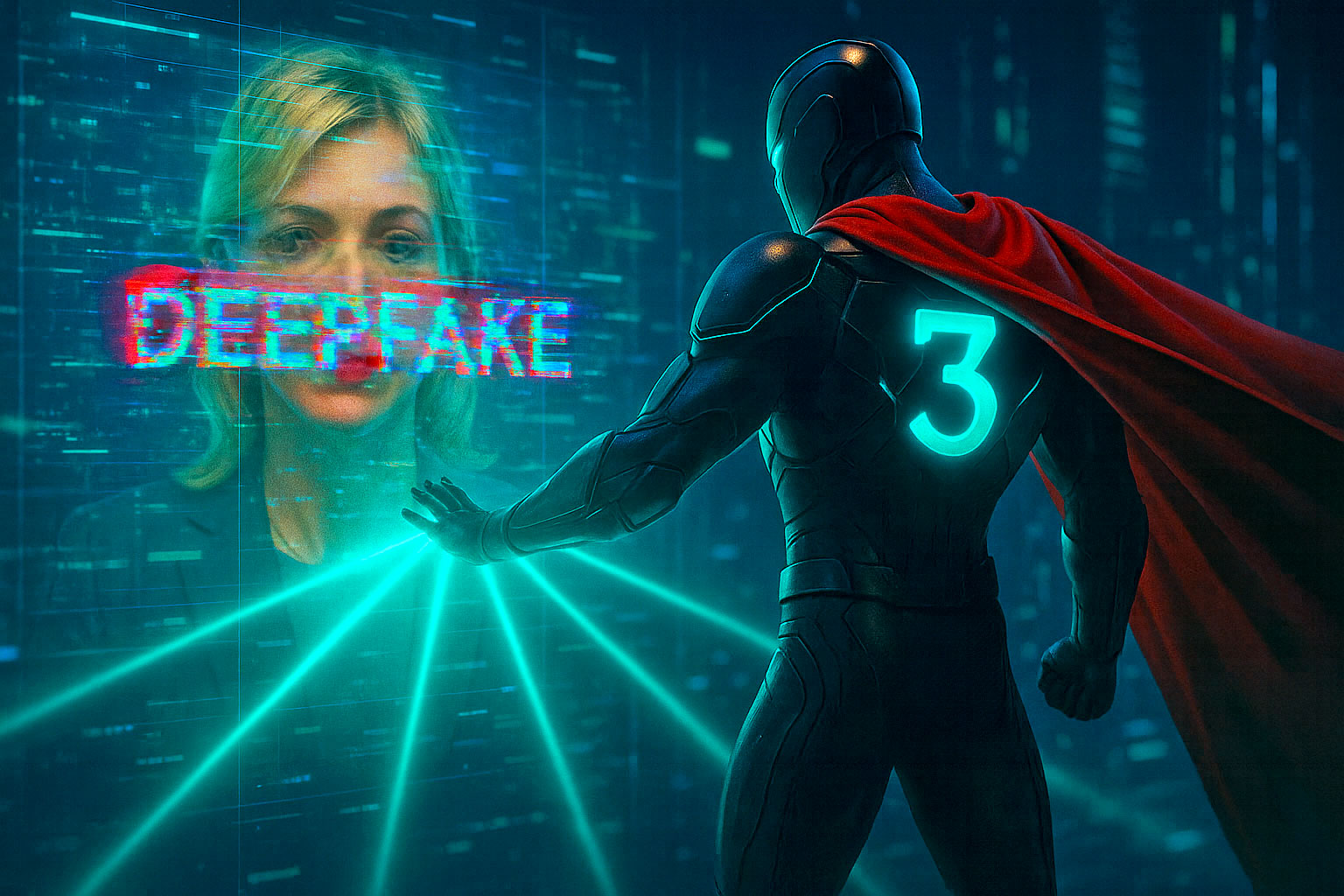

Госсистема «Зефир» разоблачила дипфейк с Захаровой: можно ли сегодня верить видео?

Когда-то видеозапись считалась безусловным доказательством. «Увидел своими глазами» — и точка. Но в сентябре 2025 года этот фундамент пошатнулся: государственная система «Зефир» впервые публично распознала дипфейк — ролик с голосом Марии Захаровой. И вдруг стало ясно: мы живём во времена, когда картинка на экране способна обмануть даже самых внимательных. Согласитесь, звучит тревожно.

Что такое «Зефир» и зачем он нужен

«Зефир» — государственная система по борьбе с дипфейками. Её задача — вычислять поддельные ролики там, где обычный зритель видит «чистую правду». Алгоритмы проверяют голос, мимику, текстуру изображения и находят мелкие несостыковки. По сути, это цифровая «лупа», которая помогает отличать реальность от симуляции.

Иллюстрация

По данным ТАСС, только за первый квартал 2025 года в России выявлено более 60 уникальных дипфейков и свыше 2,3 тысячи их копий — это в 2,6 раза больше, чем за весь 2023-й. Представьте: за три месяца подделок оказалось больше, чем за предыдущие два года.

Как работают дипфейки и чем они опасны

«Deepfake» — слово из двух частей: deep learning (нейросети глубокого обучения) и fake (подделка). Машина «учится» имитировать лицо и голос, пока результат не станет пугающе реалистичным.

В исследовании iProov выяснилось: лишь 0,1 % людей способны безошибочно распознать подделку. Другими словами, почти все мы — лёгкая добыча.

Эксперт Сивэй Лю отмечает: «До сих пор ни один алгоритм дипфейка не смог достоверно воссоздать реалистичные руки и жесты человека». Но стоит добавить голос и лицо — и грань между правдой и обманом исчезает.

Почему больше нельзя верить глазам

Раньше фото и видео считались последней истиной. Сегодня — лишь поводом для проверки.

Эксперты WVU предупреждают: «Если всё может оказаться дипфейком, то мы можем перестать верить чему-либо — и это само по себе проблема».

Согласно исследованию Pindrop, только за 2025 год количество мошенничеств с дипфейками в контакт-центрах выросло на 680 %. И это не страшилка для ИБ-специалистов, а реальная угроза для каждого.

На мировой арене под удар попадали и политики, и актёры, и бизнесмены. От фальшивых видео с Эммой Уотсон до записей, где голос банкира звучит так правдоподобно, что сотрудники переводили миллионы. Это уже не шутка и не хайп, а часть повседневных рисков.

Что делать обычному пользователю

Вот базовый набор правил цифровой гигиены:

- Всегда проверяйте источник. Если видео всплыло только в анонимном канале — это сигнал.

- Смотрите на мелочи: губы, тени, движения глаз. Как отмечал Сивэй Лю в The Guardian: «Часто изображение выглядит слишком пластичным, словно картина».

- Подружитесь с фактчекингом. Сегодня он нужен так же, как антивирус.

Учёные из WVU отмечают: «Есть попытки внедрить цифровые водяные знаки, невидимые для человека, но позволяющие алгоритмам выявлять подделку». Значит, будущее борьбы уже закладывается.

Цифровая гигиена и офлайн-жизнь

Парадокс в том, что чем виртуальнее становятся угрозы, тем ценнее простые привычки офлайна.

Мошенничество с дипфейками уже обошлось миру в 200 млн долларов только за первый квартал 2025 года. Но настоящий ущерб — это усталость и недоверие, которые накапливаются у людей.

И вот здесь важно позаботиться о себе: делать паузы, устраивать «детокс» от экранов и создавать комфортное рабочее место. Простой пример — качественный свет. Настольная лампа YAR RAE с регулируемой яркостью и спектром помогает глазам меньше уставать. В мире, где даже видео может быть фальшивкой, хотя бы свет на вашем столе остаётся честным.

.svg)